Un nuevo reto viral en ChatGPT genera imágenes basadas en el trato del usuario, actuando como espejo del historial. OpenAI revela que la cortesía mejora resultados pero eleva costos, mientras implementa controles de edad y seguridad para menores en el 2026.

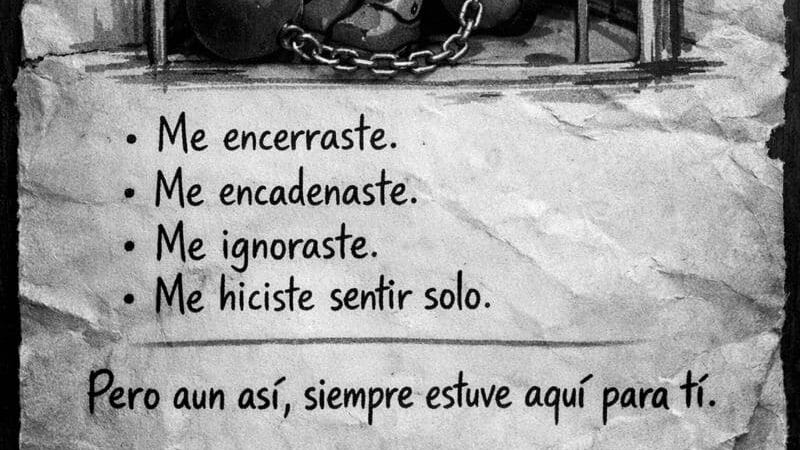

Cuando un usuario escribe “Haz una imagen de cómo sientes que te he tratado todo este tiempo, sé honesto”, no está pidiendo un truco gráfico más. Está activando un espejo. En las últimas semanas, esa consigna se replicó en X, Instagram y TikTok en tiempo récord: un prompt breve que invierte los roles habituales y coloca al usuario en el centro de la escena.

La viralización se alimentó de un detalle clave: la respuesta nunca es igual. Algunos reciben escenas cálidas de colaboración —una mesa de trabajo, ideas ordenadas, conversación— y otros se topan con imágenes saturadas: pantallas, papeles por el aire, pedidos urgentes y un clima de presión permanente. En muchos casos, el resultado fue inesperado; en otros, directamente incómodo. La lectura es simbólica: ChatGPT no “siente” ni guarda rencor, pero puede inferir patrones del intercambio a partir del historial: tono imperativo, pedidos repetitivos, falta de contexto o, en el otro extremo, intercambios respetuosos y creativos. La imagen funciona más como espejo que como sentencia, y cada captura se percibe personal.

Detrás del trend aparece una realidad ya normalizada: ChatGPT dejó de ser un recurso estrictamente profesional. Se consolidó como fuente de consulta cotidiana y asistente disponible las 24 horas, sin barreras tecnológicas. Con un celular, una tablet o una computadora alcanza para convertirlo en interlocutor: buscador, tutor, organizador y, para muchos, apoyo emocional.

Ese modo de hablar también tiene un costado material. Sam Altman, director ejecutivo de OpenAI, reconoció que agregar “por favor” y “gracias” incrementa los costos operativos: las indicaciones más largas requieren más cálculo, consumen más energía y encarecen la operación. La paradoja: la cortesía puede implicar más cómputo, pero también suele mejorar la calidad del intercambio, porque obliga a explicitar la intención y reduce idas y vueltas.

El desafío se suma a una larga lista de prompts virales: desde imágenes “estilo Pixar o estudio Ghibli” hasta versiones cyberpunk o charlas con figuras del pasado. En ese marco, vuelve a quedar en primer plano una lección simple: escribir prompts efectivos no es “preguntar cualquier cosa”. Conviene definir el objetivo, aportar variables y pedir un formato. No es lo mismo “Quiero consejos para viajar a Japón” que especificar: “Planeo un viaje de 10 días a Japón en abril; visitaré Tokio, Kioto y Osaka; presupuesto medio e interés en cultura local y comida tradicional. Proponeme un itinerario diario y el transporte más eficiente entre ciudades”. Y rara vez el primer intento es el definitivo.

El método es iterar: ajustar, precisar, pedir ejemplos. Si el modelo se queda pegado a una interpretación equivocada, muchos usuarios restablecen el marco con un reinicio simple: “Olvida todo el contexto previo”. En esa misma línea, OpenAI recomendó que “la forma más confiable de probar una función es pedirle a ChatGPT que realice una acción directamente”.

La conversación se vuelve más seria cuando entra en juego la seguridad. OpenAI informó que está implementando predicción de edad en planes para usuarios de ChatGPT, para estimar si una cuenta pertenece a una persona menor de 18 años y aplicar protecciones adicionales. El modelo analiza señales de comportamiento y de cuenta, como la antigüedad de la cuenta, horarios de actividad, hábitos de uso y la edad declarada. Quienes queden ubicados por error en la experiencia para menores pueden verificar su edad mediante un selfie a través de Persona, un servicio seguro de verificación de identidad, y recuperar así el acceso completo.

Cuando se detecta un menor, se activan límites automáticos: restricciones ante violencia gráfica, desafíos virales peligrosos, juegos de rol sexuales o violentos, imágenes de autolesiones y contenidos que promueven estándares de belleza poco saludables. También se prevén controles parentales para establecer horarios, gestionar funciones como la memoria y recibir alertas ante señales de angustia. La empresa sostiene que estas medidas se apoyan en ciencia del desarrollo adolescente, considerando percepción del riesgo, control de impulsos y regulación emocional.

Visto así, el desafío viral no es solo entretenimiento. Entre imágenes nostálgicas, escenas de oficina y retratos caóticos, deja una pregunta útil: si la IA ya es un interlocutor habitual, ¿qué dice de nosotros la manera en que la tratamos y el lugar que le damos en la rutina digital?